OpenClaw 终极入门指南:配合QwenCode 编程助手的安装、连接Discord与高阶玩法

国产Code的万金油用于加速OpenClaw

1. Qwen Code

Qwen Code是2025年8月阿里云通义千问团队推出的AI编程智能体,基于Gemini Code进行二次开发,采用终端命令行交互形态。该工具专为发挥模型在代理式编程任务中的表现而设计,支持自然语言需求理解、代码编写及工具调用

本文介绍如何在 Qwen Code(CLI 及 IDE 插件)中配置与使用阿里云百炼 Coding Plan

1.1 安装

macOS/Linux 安装最方便,WIndows比较繁琐,建议使用WSL2

bash -c "$(curl -fsSL https://qwen-code-assets.oss-cn-hangzhou.aliyuncs.com/installation/install-qwen.sh)"- 以管理员身份打开CMD

在任务栏搜索框里输入CMD,选择以管理员身份运行

- 在CMD中运行以下命令安装 Qwen Cod

curl -fsSL -o %TEMP%\install-qwen.bat https://qwen-code-assets.oss-cn-hangzhou.aliyuncs.com/installation/install-qwen.bat && %TEMP%\install-qwen.bat1.2 配置和使用

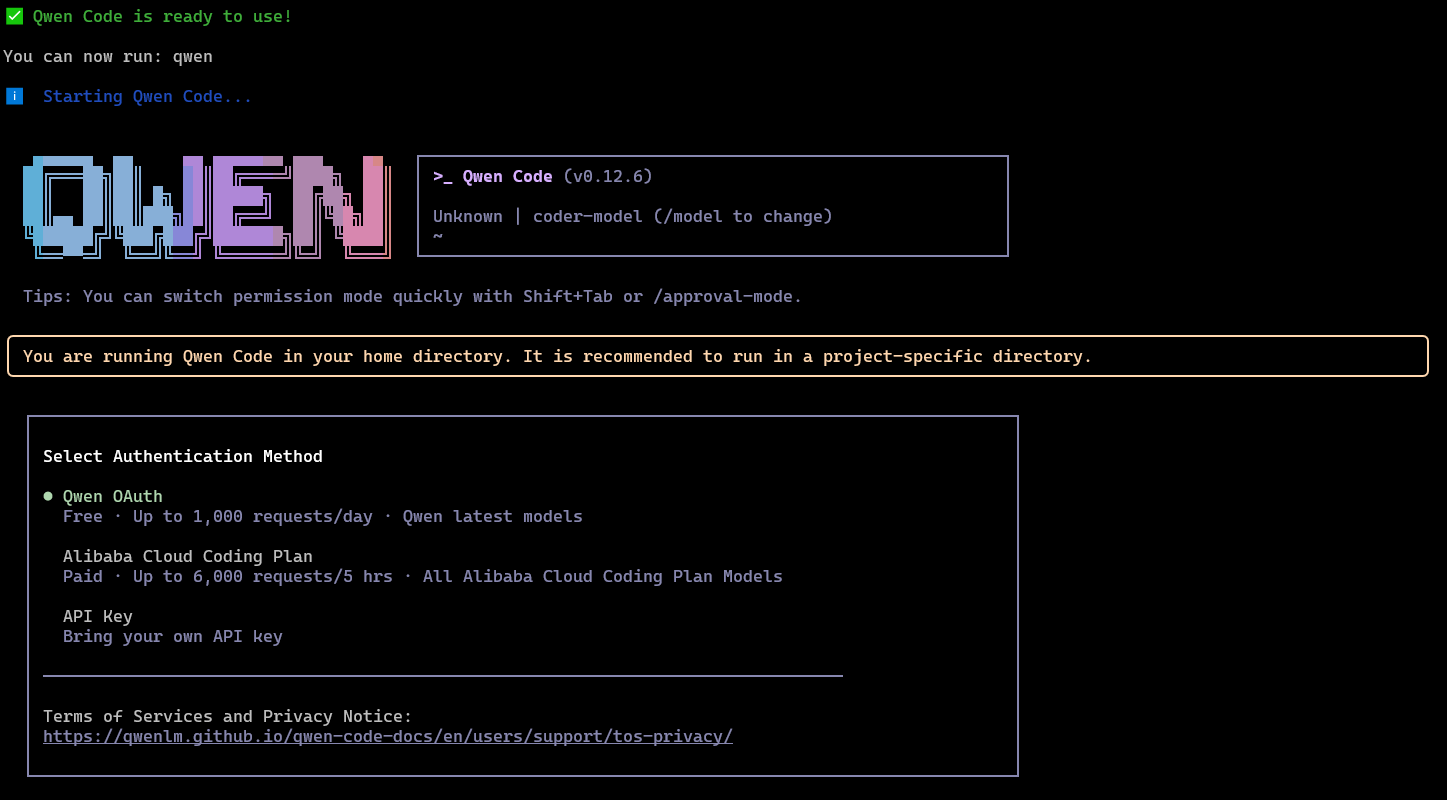

- 在Qwen Code中配置百炼的Coding Plan

- 安装完成后会自动切换到配置页面,如果没有跳转,可以使用

qwen切换到配置页面

- 看到以上界面后,按键盘的上下方向键(↑或↓)切换到阿里云百炼 Coding Plan,按回车键确认选择

- 继续使用上下方向键切换到阿里云百炼(aliyun.com),并按回车键确认选择,Qwen Code将自动设置Coding Plan的Base URL

- 找到Code Plan的接面,输入API即可

2. OpenClaw安装

openclaw的安装按照上一篇文章即可,也可以连接飞书

这里使用的是百炼大模型,所以只要安装到可以启动openclaw即可

最方便的方式

# npm可控 可升级

npm install -g openclaw@latest

openclaw onboard --install-daemon安装好之后按照下面的进行设置

| 配置项 | 配置内容/选择 | 说明 |

|---|---|---|

| 风险提示确认 | Yes |

确认理解潜在风险并继续。 |

| Onboarding mode | QuickStart |

选择快速启动模式,跳过繁琐设置。 |

| Model/auth provider | Skip for now |

暂时跳过模型/认证提供商配置,后续可在设置中完成。 |

| Filter models by provider | All providers |

显示所有可用的模型提供商。 |

| Default model | Keep current (default: anthropic/claude-opus-4-6) |

保持默认。 |

| Select channel (QuickStart) | Skip for now |

暂时跳过通知渠道配置。 |

| Search provider | DuckDuckGo Search (experimental) | 新增加的选项 |

| Configure skills now? | No |

暂时不配置技能插件,后续按需添加。 |

| Enable hooks? | Skip for now |

操作提示:在终端界面中,按 空格键 选中该项,然后按 回车键 进入下一步。 |

| How do you want to hatch your bot? | Hatch in TUI |

选择在当前终端用户界面 (TUI) 中启动机器人。 |

网页搜索API也选择跳过即可

3. openclaw配置百炼大模型

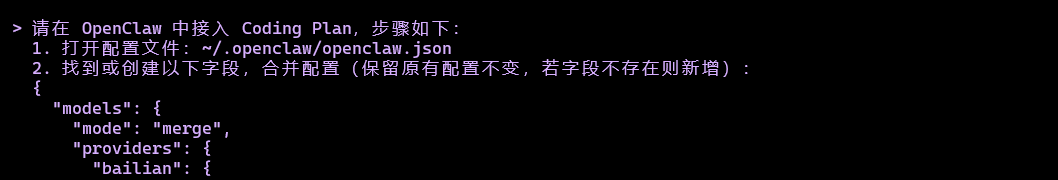

3.1 使用Qwen Code配置

在安装好千问后,打开Qwen CLI,然后把下面的话输入到CLI终端

注意把API Key 转换成自己的Code Plan API Key

第一步: 使用code进行配置,当然也可以使用claude code,opencode进行操作

请在 OpenClaw 中接入 Coding Plan,步骤如下:

1. 打开配置文件:~/.openclaw/openclaw.json

2. 找到或创建以下字段,合并配置(保留原有配置不变,若字段不存在则新增)

{

"models": {

"mode": "merge",

"providers": {

"bailian": {

"baseUrl": "https://coding.dashscope.aliyuncs.com/v1",

"apiKey": "YOUR_API_KEY",

"api": "openai-completions",

"models": [

{

"id": "qwen3.5-plus",

"name": "qwen3.5-plus",

"reasoning": false,

"input": ["text", "image"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 1000000,

"maxTokens": 65536,

"compat": {

"thinkingFormat": "qwen"

}

},

{

"id": "qwen3-max-2026-01-23",

"name": "qwen3-max-2026-01-23",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 262144,

"maxTokens": 65536,

"compat": {

"thinkingFormat": "qwen"

}

},

{

"id": "qwen3-coder-next",

"name": "qwen3-coder-next",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 262144,

"maxTokens": 65536

},

{

"id": "qwen3-coder-plus",

"name": "qwen3-coder-plus",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 1000000,

"maxTokens": 65536

},

{

"id": "MiniMax-M2.5",

"name": "MiniMax-M2.5",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 196608,

"maxTokens": 32768

},

{

"id": "glm-5",

"name": "glm-5",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 202752,

"maxTokens": 16384,

"compat": {

"thinkingFormat": "qwen"

}

},

{

"id": "glm-4.7",

"name": "glm-4.7",

"reasoning": false,

"input": ["text"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 202752,

"maxTokens": 16384,

"compat": {

"thinkingFormat": "qwen"

}

},

{

"id": "kimi-k2.5",

"name": "kimi-k2.5",

"reasoning": false,

"input": ["text", "image"],

"cost": { "input": 0, "output": 0, "cacheRead": 0, "cacheWrite": 0 },

"contextWindow": 262144,

"maxTokens": 32768,

"compat": {

"thinkingFormat": "qwen"

}

}

]

}

}

},

"agents": {

"defaults": {

"model": {

"primary": "bailian/qwen3.5-plus"

},

"models": {

"bailian/qwen3.5-plus": {},

"bailian/qwen3-max-2026-01-23": {},

"bailian/qwen3-coder-next": {},

"bailian/qwen3-coder-plus": {},

"bailian/MiniMax-M2.5": {},

"bailian/glm-5": {},

"bailian/glm-4.7": {},

"bailian/kimi-k2.5": {}

}

}

},

"gateway": {

"mode": "local"

}

}

3. 保存配置文件

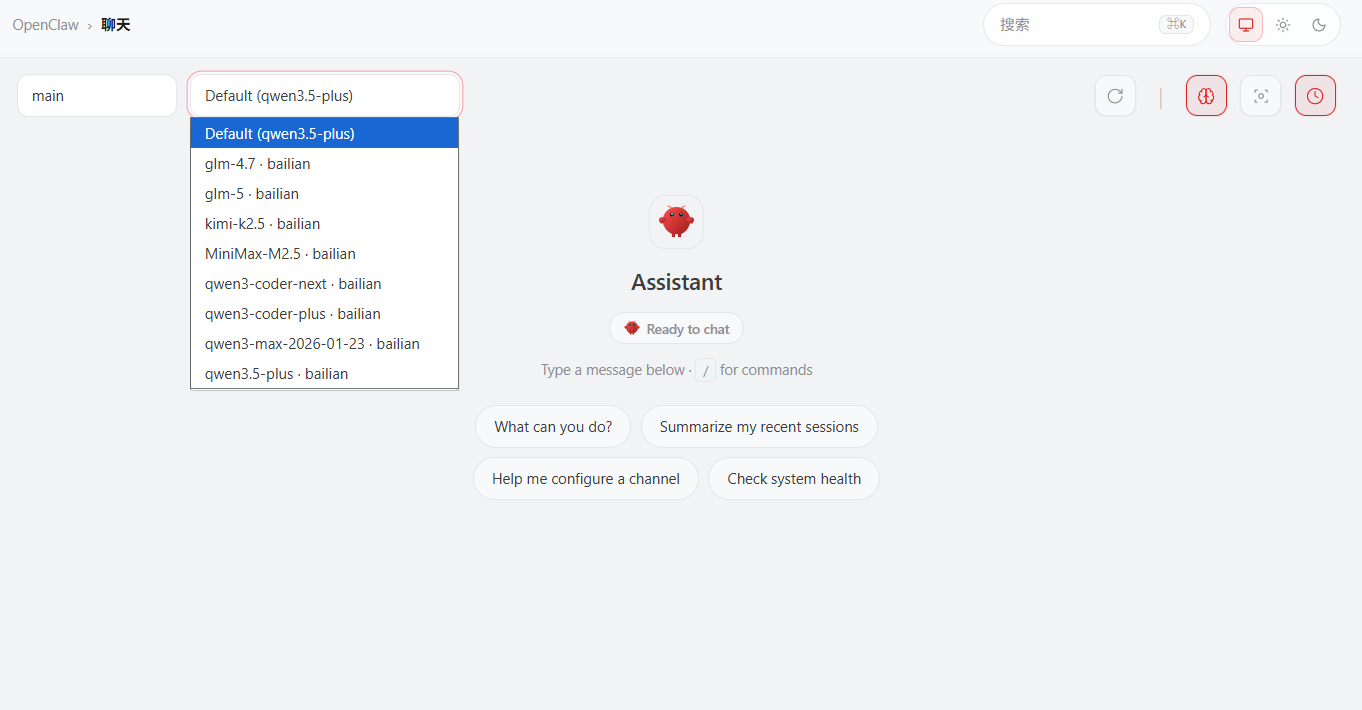

4. 运行 openclaw gateway restart,重启Openclaw的网关,使配置生效。第二步:启动openclaw dashboard进行查验

在终端输入openclaw dashboard,然后给到链接,点击进入本地网页进行聊天,也可以选择切换不同的模型,非常适合多agent

3.2 手动配置

也可以手动将模型的选择配置添加到文件中

- 在终端执行下面的命令打开配置

# nano或vim都可以

nano ~/.openclaw/openclaw.json- 首次配置:复制以下内容到配置文件。将YOUR_API_KEY替换为Coding Plan 专属 API Key

- 已有配置:若需保留已有配置,请勿直接全量替换

需要注意配置过程中,models文件放置的位置,尤其是递进关系,本身只要安装了就会有配置文件内容产生

4. Discord 设置

Discord 是一款免费的社交即时通讯软件,最初专为游戏玩家设计,现已发展为集文字、语音、视讯沟通于一体的社群平台。用户可在“伺服器”(Server)中建立主题频道,适用于多人组队游戏、社群交流、在线办公或分享兴趣爱好,支持 Windows、macOS、Android、iOS 和网页端

在Discord世界里,不存在任何“算法推荐”要素,比如不会收到系统发来的社区推荐,更不用说夹带私货的广告。如要加入一个社区服务器,主要途径就是去“发现”页面进行特别古典的“搜索”;或者更古典的,通过口碑相传的方式,收到链接邀请加入社区。我们可以把Discord可以理解为是一个社交媒体的综合体, 它包括了实时通讯,文字,语音,视频,直播,小组功能,组群区分,丰富的机器人协助系统,并集成了YouTube等其他的网站,满足了从个人到组织到公司或者项目的不同需求

Discord创建bot有点类似飞书,也是需要创建一个应用,然后在应用里面添加Bot,赋予Bot各种权限

需要解决网络问题,discord多频道非常适合多agent合作

4.1 创建频道

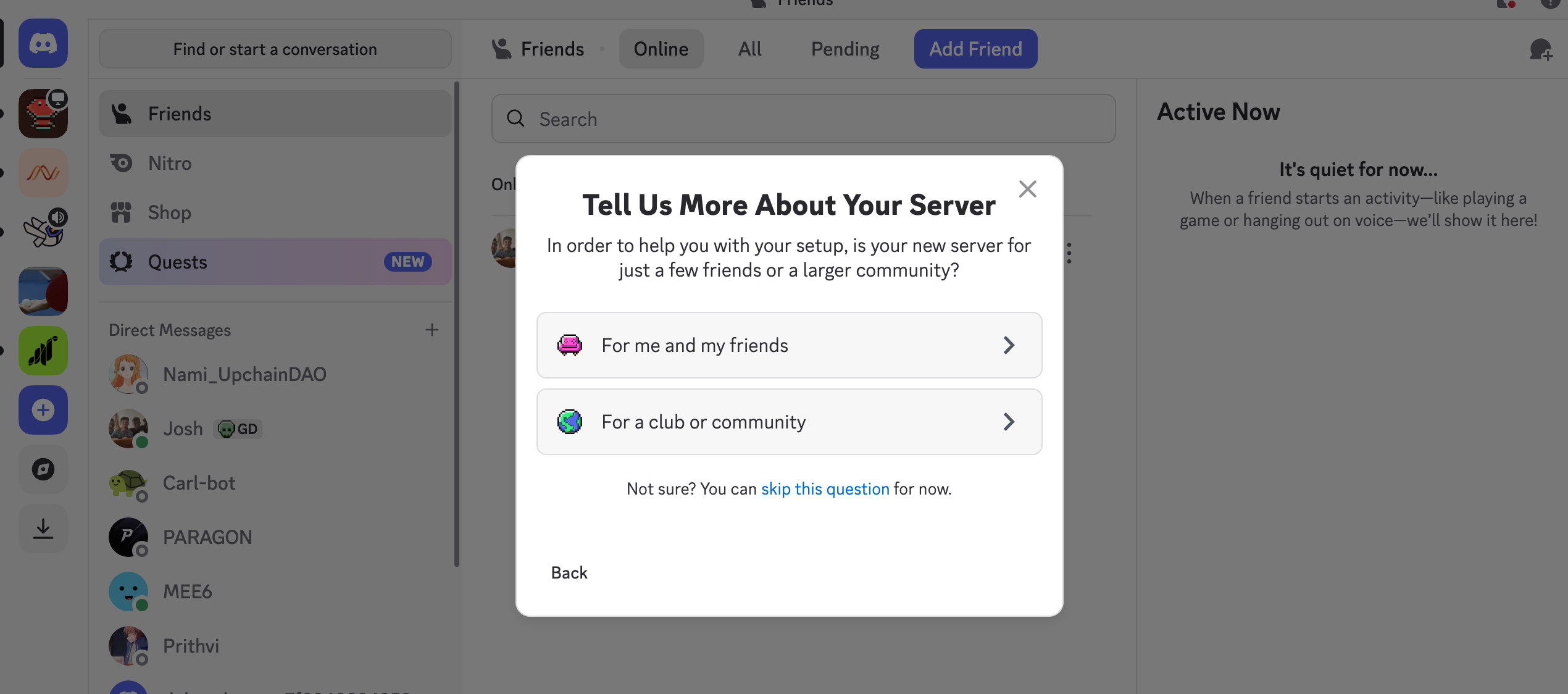

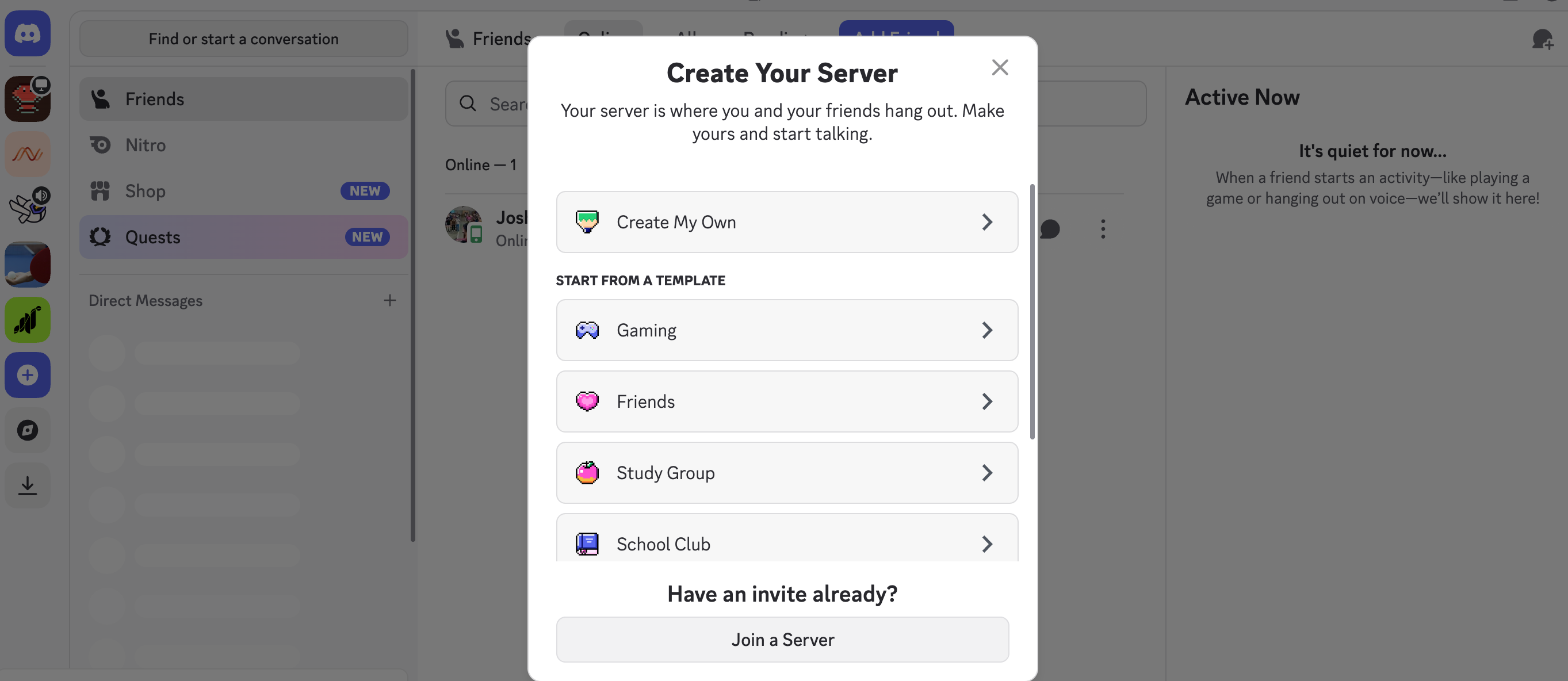

进入官网点击图中的+号创建一个服务器

选择亲自创建(Create My Own)

- 选择仅供我和我的朋友使用

- 自己设定一个频道的名字

非常简单即可创建成功!

4.2 创建bot

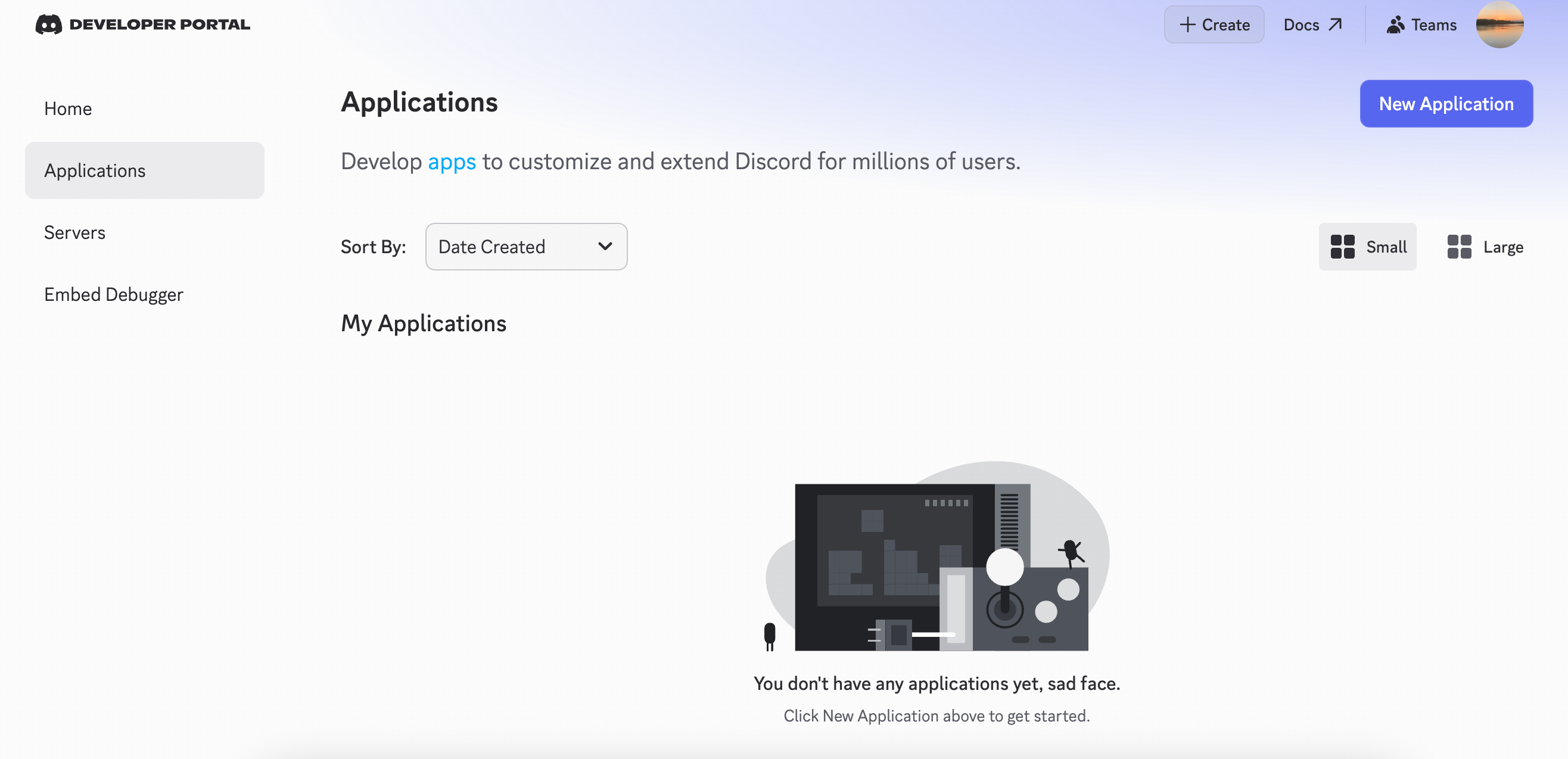

访问开发者后台,这个和discord官网是两个地址,类似你自己的设置后台,只能网页进入

- 点击右上角创建一个应用,输入应用名称

- 自动跳转到通用信息页面

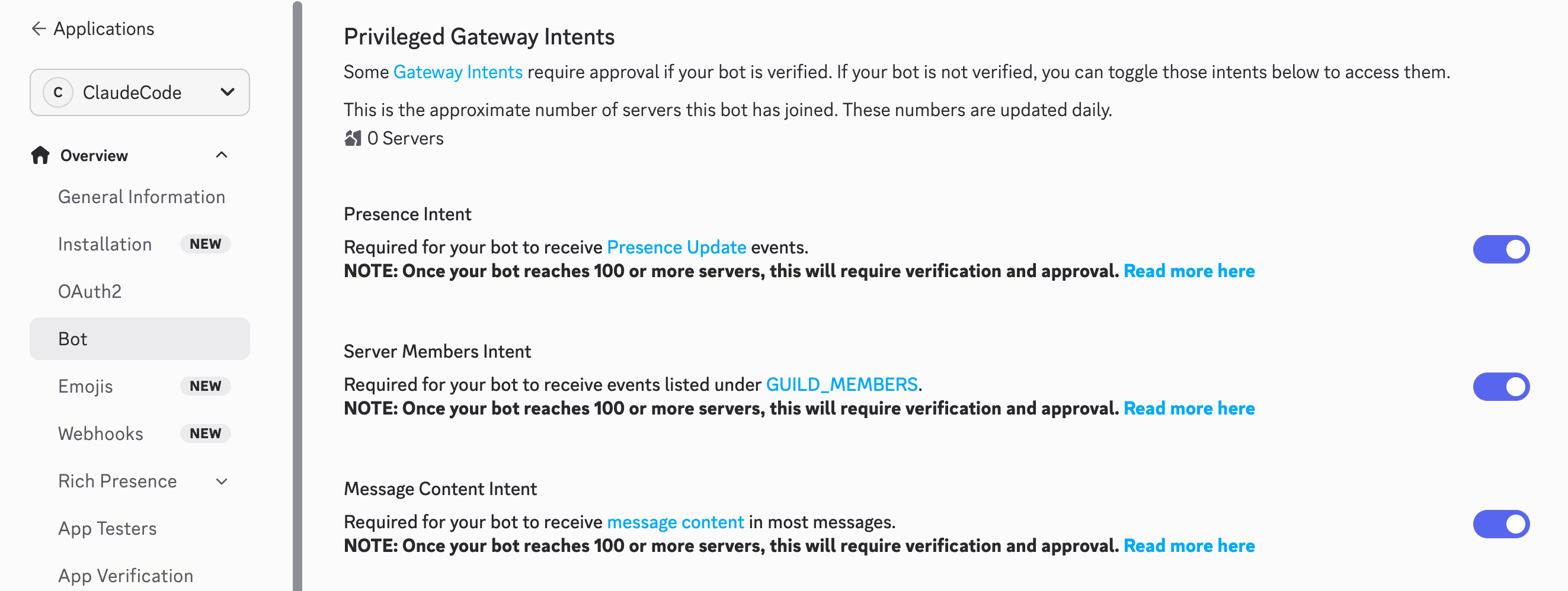

- 点击左侧的

Bot菜单,然后点击Reset Token - 重置后,记得复制你的Token,这个Token非常重要,不要丢失

- 下滑后,全部选择图中的选项,用来设置bot接收消息内容

- Bot Permissions不需要选择

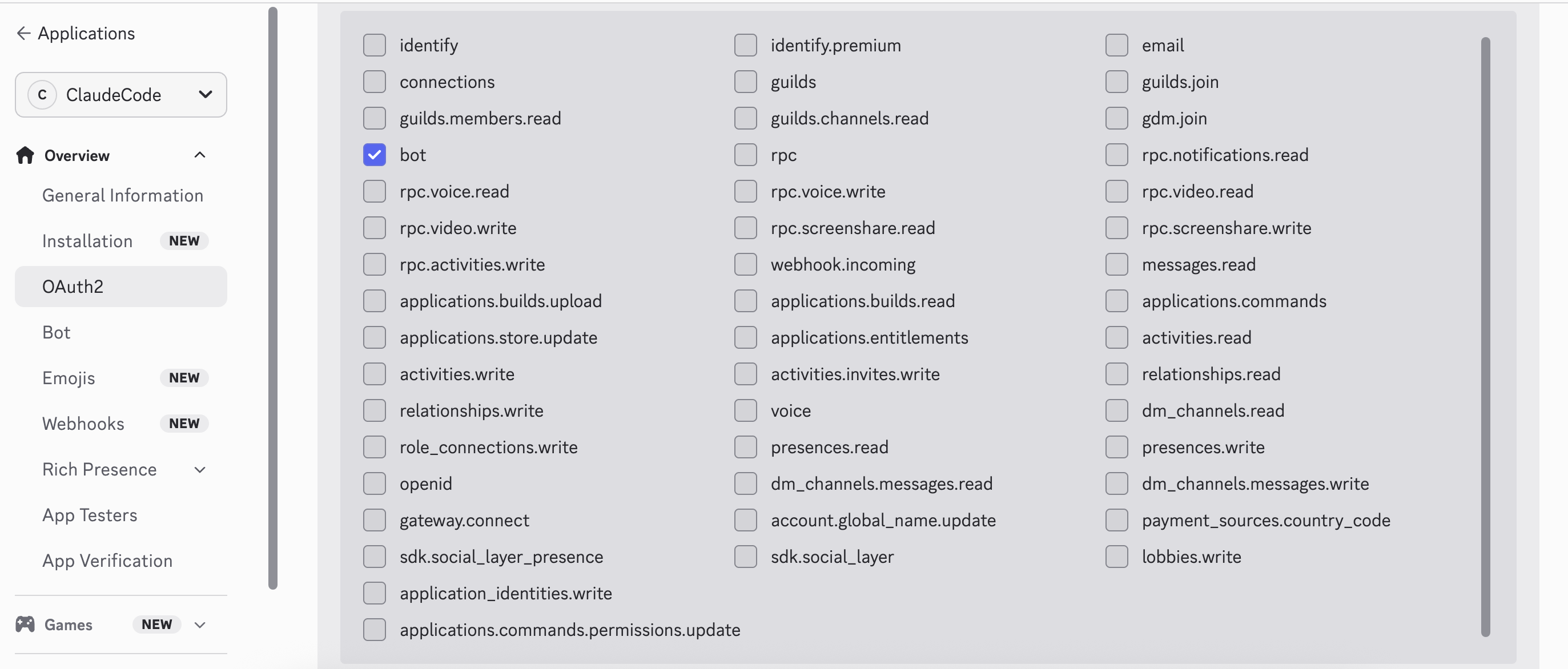

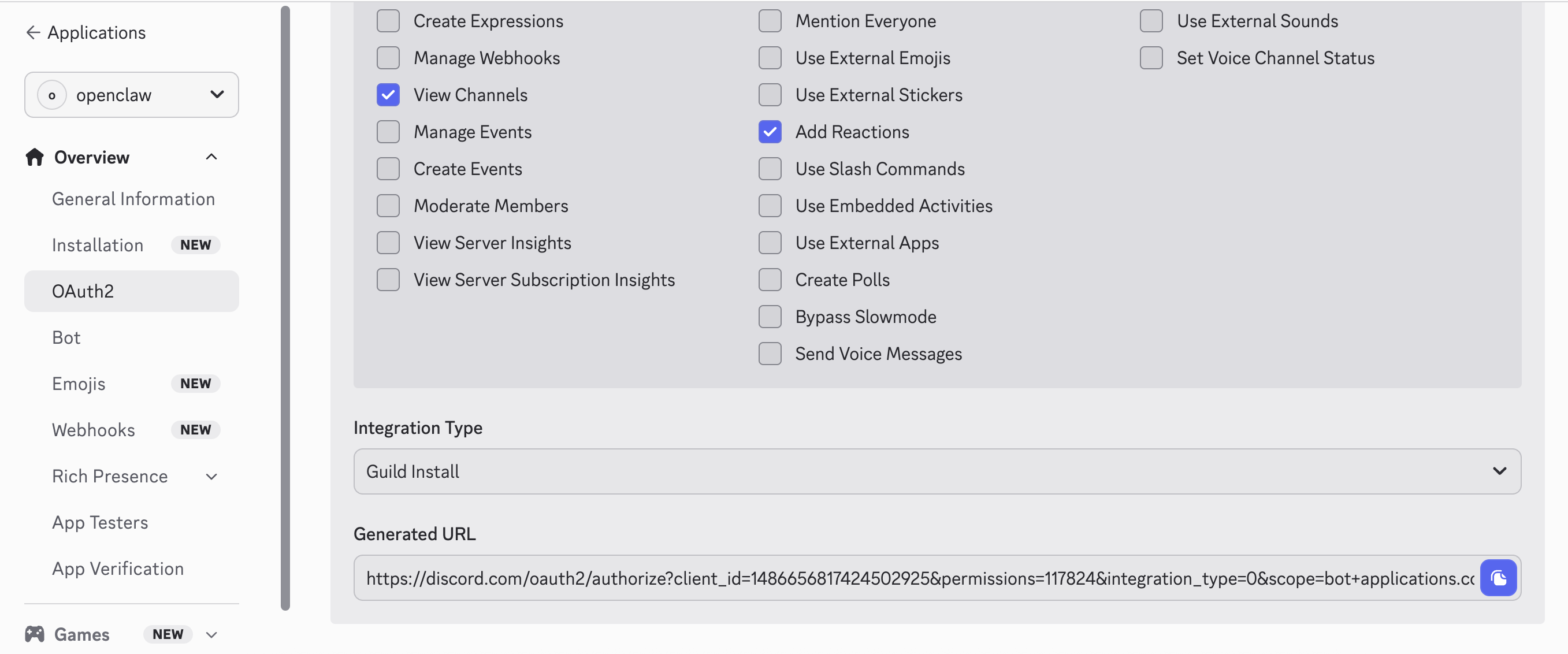

- OAuth2 配置页面

- 按照图中的显示,在

OAuth2 URL Generator选择bot选项和applications.commands - 继续向下滚动,找到 Bot Permissions,勾选 View Channels、Send Messages、Read Message History、Embed Links、Attach Files、Add Reactions (可选)

- 在

Generated URL,点击复制连接,然后在别的浏览器tab中打开

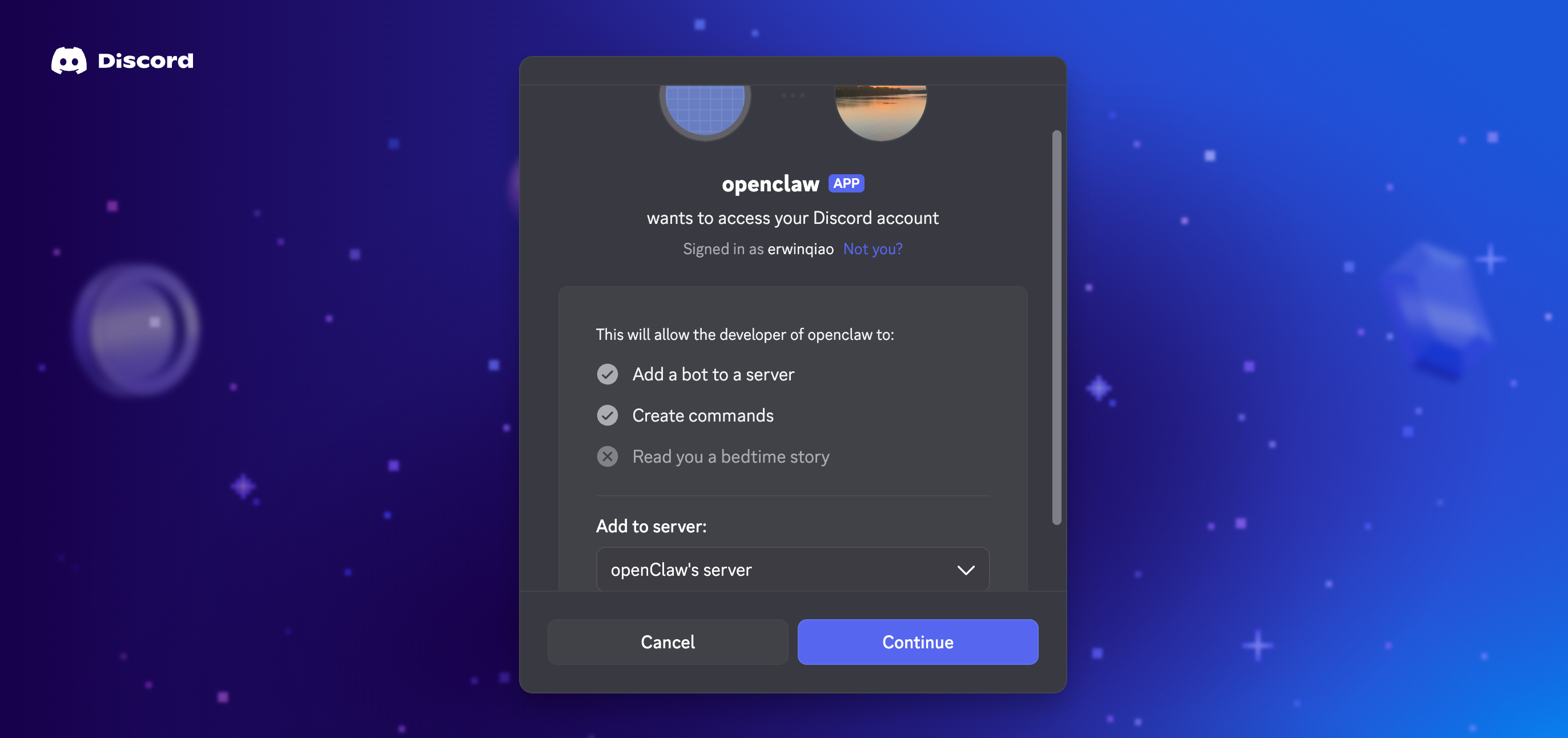

- 将 Bot 加入服务器

在浏览器中打开刚才复制的链接,选择一个服务器(相当于将创建的机器人加入该服务器),选择前面创建的自定义服务器。

(fig-alt=“discord09” fig-align=“center”)

(fig-alt=“discord09” fig-align=“center”)

- 查验是否加入bot 切换到discord官网,找到创建的Server,然后查看是否机器人加入了频道

注意下面的botxxxx信息

4.3 连接Discord

- 在终端中设置启动命令

openclaw onboard --install-daemon

跳转到下面一步的时候选择discord

│

◆ Select channel (QuickStart)

│ ○ Telegram (Bot API)

│ ○ WhatsApp (QR link)

│ ● Discord (Bot API) (needs token)

│ ○ IRC (Server + Nick)

│ ○ Google Chat (Chat API)

│ ○ Slack (Socket Mode)

│ ○ Signal (signal-cli)

│ ○ iMessage (imsg)

│ ○ LINE (Messaging API)

│ ○ Feishu/Lark (飞书)

│ ○ Nostr (NIP-04 DMs)

│ ○ Microsoft Teams (Teams SDK)

│ ○ Mattermost (plugin)

│ ○ Nextcloud Talk (self-hosted)

│ ○ Matrix (plugin)

│ ○ BlueBubbles (macOS app)

│ ○ Zalo (Bot API)

│ ○ Zalo (Personal Account)

│ ○ Synology Chat (Webhook)

│ ○ Tlon (Urbit)

│ ○ Twitch (Chat)

│ ○ Skip for now

└- 输入上一步保存的

Token,然后回车

◇ Configure Discord channels access?

│ Yes

│

◆ Discord channels access

│ ● Allowlist (recommended)

│ ○ Open (allow all channels)

│ ○ Disabled (block all channels)

└- 需要输入允许的allowlist,主要是服务器/频道,可以输入多个,后面再进行设置

◆ Discord channels allowlist (comma-separated)

│ My Server/#general, guildId/channelId, #support- 一路确认即可,没有的API就选择No,需要的就选择Yes,最后选择在TUI界面启动,询问是否连接

discord即可

大部分无法连接成功都是因为网络问题,这个时候建议使用国内的通讯软件进行连接即可

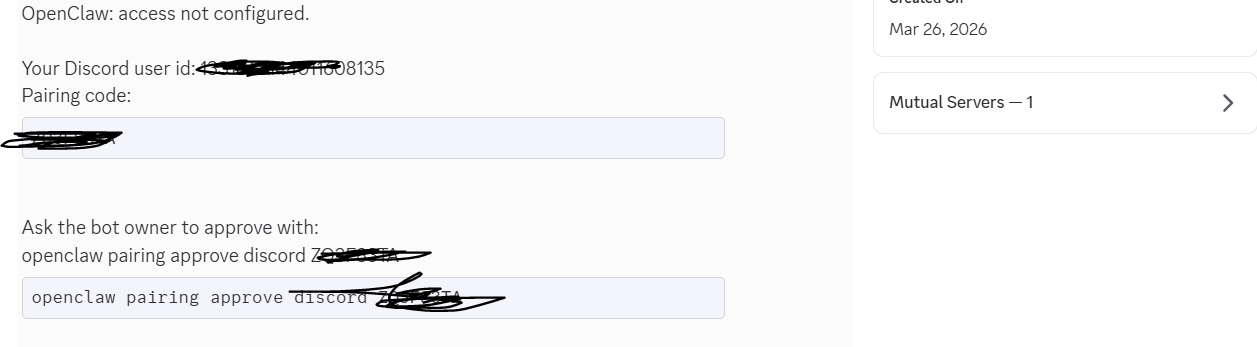

- 在discord频道中发消息给bot,会提醒你出现配对码,并且给你命令提示,在终端中输入

openclaw pairing approve discord xxxxxx恭喜你完成了单个Agent的配对Discord

5. 多Agent配置

同样的多Agent就像是单Agent组合而成的,按照上面的步骤继续构建Discord Bot

多Agent是OpenClaw的核心特性之一,每个Agent都是一个独立的虚拟员工,拥有自己的、

- Workspace(工作区):存储配置文件和长期记忆

- SOUL(灵魂):定义性格、行为准则和能力边界

- Memory(记忆):保持对话上下文和历史信息

- Skills(技能):可以调用的工具和能力

在 OpenClaw 中实现多 Agent 和多 Bot 的核心是路由(Routing)机制。这意味着你可以通过一个统一的网关(Gateway)来管理多个职责、人格、模型各不相同的 Agent,并将来自不同聊天机器人(Bot)或频道的请求精准地分发给它们

不同 Agent 拥有不同的权限和能力:

- 限制敏感操作的访问范围

- 按需分配 Skills 和工具

- 实现细粒度的安全控制

专业化分工

- Coder Agent:专门处理代码审查、技术问题

- Support Agent:负责用户支持、问题解答

- PM Agent:管理项目进度、协调任务

5.1 Agent管理

- 查看所有Agent

# 列出所有 Agent

openclaw agents list

# 详细信息

openclaw agents list --verbose输出例子

Agents:

✓ main (default)

- Workspace: ~/.openclaw/agents/main

- Status: Active

- Skills: 5

✓ coder

- Workspace: ~/.openclaw/agents/coder

- Status: Active

- Skills: 8

✓ support

- Workspace: ~/.openclaw/agents/support

- Status: Active

- Skills: 35.2 创建新的Agent

在终端输入下面的命令进行新Agent的创建

# 创建名为 coder 的 Agent

openclaw agents add coder

# 创建并指定工作区路径

openclaw agents add support --workspace ~/my-agents/support- 在终端输入

openclaw agents add coder - 开始一步步提醒,创建工作区

openclaw agents add coder

🦞 OpenClaw 2026.4.11 (769908e)

If it works, it's automation; if it breaks, it's a "learning opportunity."

11:40:27+08:00 [plugins] feishu_doc: Registered feishu_doc, feishu_app_scopes

11:40:27+08:00 [plugins] feishu_chat: Registered feishu_chat tool

11:40:27+08:00 [plugins] feishu_wiki: Registered feishu_wiki tool

11:40:27+08:00 [plugins] feishu_drive: Registered feishu_drive tool

11:40:27+08:00 [plugins] feishu_bitable: Registered bitable tools

┌ Add OpenClaw agent

│

◆ Workspace directory

│ /home/erwin/.openclaw/workspace/coder█

└- 是否复制

main的配置,选择No

◆ Copy auth profiles from "main"?

│ ○ Yes / ● No- 是否配置模型信息,选择

No,不需要开始从头设置API,机器人等

◆ Configure model/auth for this agent now?

│ ○ Yes / ● No- 把第二个机器人的密钥或者App,Token等信息发给openclaw让它进行配置即可,自己设定好使用的模型和工具的权限,最后选择在TUI界面启动即可

openclaw会自动重启网关,耐心等待即可